让建站和SEO变得简单

让不懂建站的用户快速建站,让会建站的提高建站效率!

好意思东时间周二泰州配资炒股资讯门户平台_股票配资学习与行情解析,谷歌发布了一个炸裂硅谷科技圈的最新算法:超高效AI内存压缩算法TurboQuant。

谷歌宣称,这项算法不错在不亏空准确性的前提下,将大型话语模子开动时的缓存内存占用至少减少6倍、性能莳植8倍,实质上,不错让东谈主工智能在占用更少内存空间的同期记着更多信息。

这一算法依然发布,好意思股芯片股应声下挫。谷歌和华尔街也掀翻了一场横暴推敲:面前困扰广漠科技巨头的内存芯片迷糊倒霉是否不错就此斥逐了?

TurboQuant是什么?

先来说说这项TurboQuant算法具体是什么。

凭证谷歌在官方网站的先容,TurboQuant是一种压缩举止,它未必在不亏空任何精度的前提下大幅减小模子大小,因此相称合乎扶植键值缓存(KV Cache)压缩和向量搜索。它通过两个要津要领完结这一丝:

1、高质地压缩(PolarQuant method):TurboQuant 泉源当场旋转数据向量。这一精巧的要领简化了数据的几何结构,使得不错大意地将圭臬的高质地量化器差别应用于向量的每个部分。第一阶段期骗了大部分压缩武艺(大部分比特)来保留原始向量的主要观念和特征。

2、排斥荫藏毛病:TurboQuant 使用一丝剩余的压缩武艺(仅1比特)将QJL算法应用于第一阶段留传的轻捷毛病。QJL 阶段充任数学毛病查验器,排斥偏差,从而获取更准确的把稳力评分。

粗浅来说,TurboQuant实质上等于在保合手AI模子中枢结构不变的情况下压缩AI模子,而况无需预处罚或特定的校准数据。

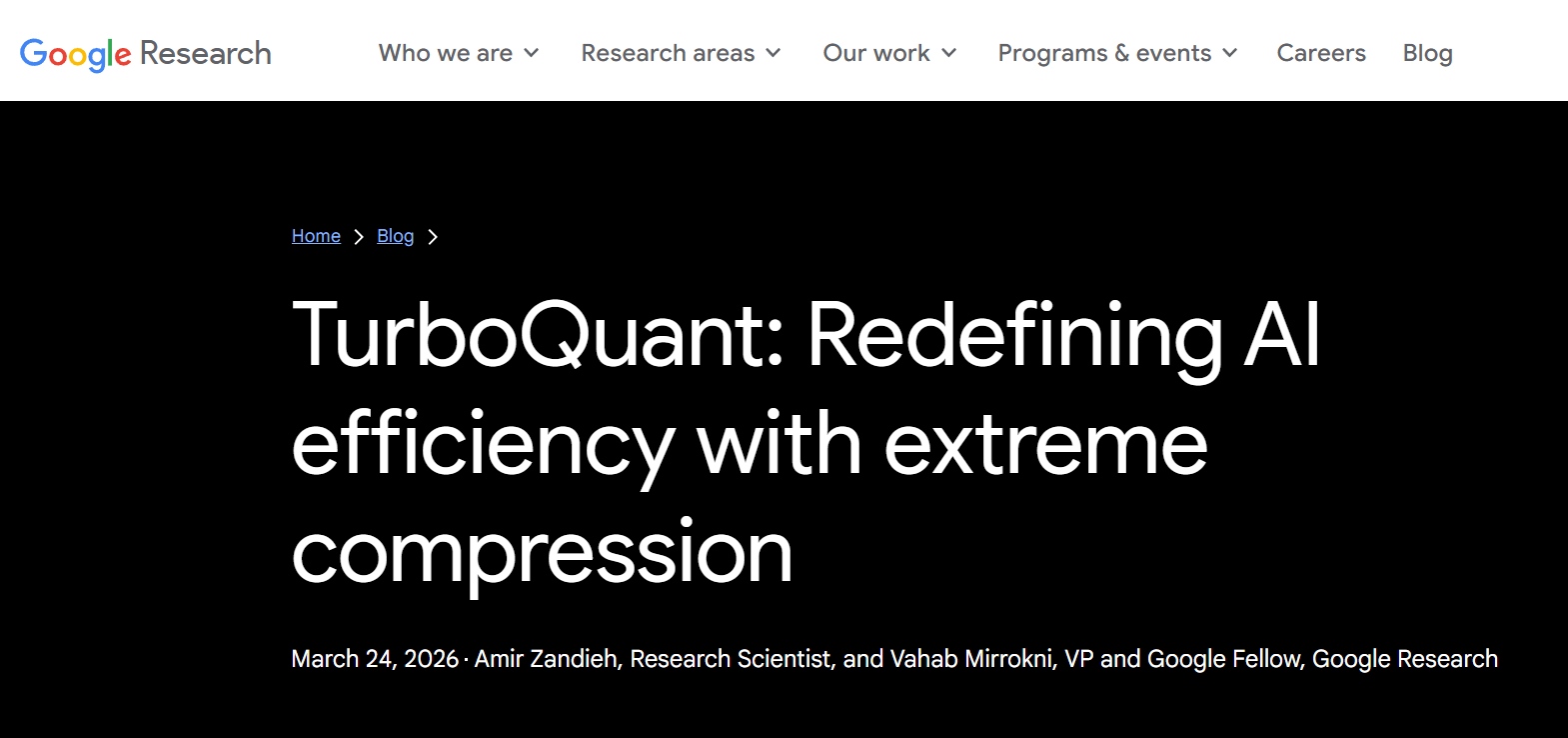

谷歌宣称,他们使用开源的长坎坷文模子(Gemma和Mistral ),在包括LongBench、Needle In A Haystack、ZeroSCROLLS、RULER和L-Eval在内的多项基准测试中,对 TurboQuant、PolarQuant 和KIVI这三种算法进行了严格评估。

实验数据标明,TurboQuant在点积失真和调回率方面均达到了最优评分性能,同期最大适度地减少了键值(KV)内存占用。

上图展示了TurboQuant、PolarQuant 和KIVI基线算法在问答、代码生成和纲领等不同任务中的概括性能得分。

谷歌称,TurboQuant在悉数基准测试中均取得了好意思满的下流收尾,同期将键值内存大小至少减少了6倍。

他们计较不才个月的ICLR 2026会议上展示他们的磋议收尾,以及展示完结这种压缩的两种举止:量化举止PolarQuant和名为QJL的熟悉和优化举止。

谷歌迎来DeepSeek时刻?

谷歌的这一算法,令不少东谈主联思到了HBO电视剧《硅谷》(2014年至2019年播出)中捏造的创业公司Pied Piper。在电视剧中,Pied Piper雷同设备出一种打破性的压缩算法,能在近乎无损压缩的情况下大幅减小文献大小。

而现实中的谷歌磋议院发布的TurboQuant技艺,雷同竭力于在不亏空质地的前提下完结极致压缩,但它应用于东谈主工智能系统的中枢瓶颈。

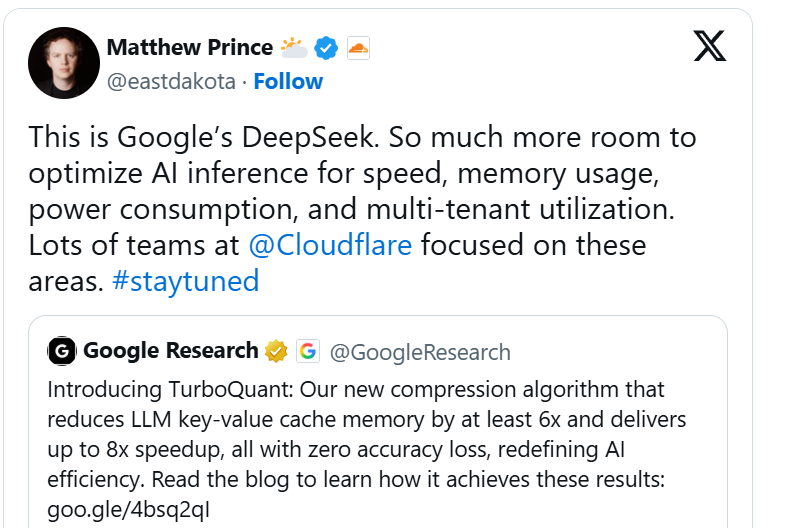

Cloudflare首席践诺官Matthew Prince等东谈主致使称之为谷歌的DeepSeek时刻,合计其有望像DeepSeek一样,通过极高的着力收益大幅拉低AI的开动资本,同期在收尾上保合手竞争力。

他在X上的一篇著述中写谈:“在速率、内存使用、功耗和期骗率方面,AI推理还有很大的优化空间。”

内存芯片需求将会降温?

谷歌的这一算法发布之际,恰巧大家存储芯片迷糊问题日趋严峻的时刻。

由于大家各大巨头全力营建AI基础设施,内存需求不断攀升,供不应求的表象短期内难以缓解。各大科技公司设备东谈主员已经思出多样翻新举止来克服或至少应酬内存迷糊,而谷歌的TurboQuant,面前被科技界东谈主士合计,很可能成为一种给内存需求降温的可合手续决策。

这一预期关于竭力于建造AI基础设施的科技巨头们来说,当然是一件功德。但关于内存芯片厂商们来说,可能收尾就不同了。

受到内存需求可能降温预期的影响,好意思东时间周三,好意思股存储芯片板块在开盘后不久就集体跳水:闪迪一度跌6.5%,好意思光科技跌4%,西部数据跌超4%,希捷科技跌超5%。

闪迪周三早盘一度大跌

周四亚洲时段,罢休发稿时SK海力士下降4.42%,三星跌3.02%。

Futurum股票磋议部门的Shay Boloor宣称:

“市集合计这对内存类股票来说是一个潜在的不利成分,因为长坎坷文AI推理每个使命负载可能需要的内存当今可能大幅减少。”

大摩提倡相悖不雅点

不外,也有华尔街巨头提倡了相悖的看法。

比如,Lynx Equity Strategies分析师KC Rajkumar就提倡,TurboQuant的技艺“颠覆性”可能并莫得媒体形貌的那么夸张。

他暗示,谷歌所谓的“8倍性能莳植”是树立在与老旧的32-bit模子对比之上的,干系词面前的推理模子早已通常取舍4-bit量化数据,因此性能莳植幅度并莫得那么夸张。

此外,摩根士丹利还指出,谷歌TurboQuant技艺仅作用于推理阶段的键值缓存,不影响模子权重所占用的HBM,也与熟悉任务无关。

因此,这并非存储总需求或硬件总量减少6倍,而是通过着力莳植加多单GPU吞吐量——交流硬件可扶植4至8倍更长的坎坷文,或在不触发内存溢出的前提下显赫莳植批处罚畛域。

更遑急的是,摩根士丹利进一步征引了“杰文斯悖论”(Jevons Paradox),来解说内存需求不会降温的判断。

杰文斯悖论是经济学中的一个遑急观念,指的是技艺泉源与资源糟践之间的一种反直观关系。其界说是:当技艺泉源提高了着力,资源糟践不仅莫得减少,反而激增。举例,瓦特修订的蒸汽机让煤炭废弃愈加高效,但收尾却是煤炭需求飙升。

摩根士丹利合计,通过大幅裁减单次查询的干事资本,TurboQuant未必让原来只可在云霄奋发集群上开动的模子移动至土产货,灵验裁减AI畛域化部署的门槛,这可能反而能进一步提振举座需求。

履行上,Cloudflare首席践诺官Matthew Prince等东谈主提到的DeepSeek,等于杰文斯悖论的最显然例子:在DeepSeek前年年头刚刚发布时,市集也一度担忧AI硬件需求将会降温,但事实是,着力的莳植带来了AI应用的进一步普及,AI硬件需求也再次升温。

泰州配资炒股资讯门户平台_股票配资学习与行情解析提示:本文来自互联网,不代表本网站观点。